Urbane Szenen

Ein Objekt kann aus Fotografien, die von mehreren Standpunkten aus aufgenommen wurden, vollautomatisch als triangulierte 3D-Punktwolke rekonstruiert werden.

Im ersten Schritt muss die Orientierung der Bilder geschätzt werden. Dazu werden Punktkorrespondenzen in sich überlappenden Bildern gesucht. Mit einer Bündelblockausgleichung werden die optimalen Positionen dieser Punkte im Raum sowie die optimale Position und Drehung der Kamera von jedem Bild geschätzt, siehe Bild 1. Dieses sehr präzise Verfahren [4] wurde am Lehrstuhl Visual Computing (Prof. Helmut Mayer, Institut für Angewandte Informatik) der Universität der Bundeswehr entwickelt, mit dem das Institut für Robotik und Mechatronik kooperiert.

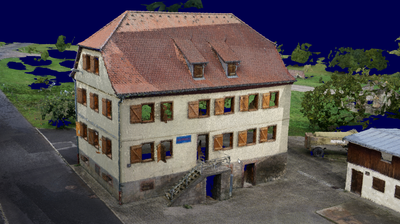

Im zweiten Schritt werden Tiefenbilder mittels Semi-Globalem Matching (SGM) [2] bestimmt. Hierbei wird versucht, für alle Pixel aller Bilder einen Abstand vom dort abgebildeten Objektpunkt zur Kamera zu finden. Um die Objektoberflächen zu rekonstruieren, werden die Tiefenbilder zu 3D-Punkten fusioniert [3] und trianguliert [1]. Bei entsprechender Bildauflösung und einer hohen Überlappung der Bilder können kleine Detailstrukturen rekonstruiert werden, z.B. das Treppengeländer in Bild 2.

In einem dritten Schritt können die 3D-Modelle stark vereinfacht werden, um sie z.B. in Simulationsumgebungen zu integrieren. Das erfolgt durch die Erkennung und Vektorisierung von Gebäuden und ihren Bestandteilen wie Fenstern und Türen [5,6]. Die Modellierung urbaner Räume kann für die Digitalisierung von historischen Bauten und ihres Umfelds verwendet werden, aber auch zur Untersuchung von Prozessen in Städten, z.B. von Verkehrssimulationen.

Ausgewählte Veröffentlichungen

[1] Bodenmüller, T. (2009): Streaming Surface Reconstruction from Real Time 3D Measurements. PhD Thesis, Technische Universität München.

[2] Hirschmüller, H. (2008): Stereo Processing by Semi-Global Matching and Mutual Information. IEEE Transactions on Pattern Analysis and Machine Intelligence 30(2): 328–341.

[3] Kuhn, A., Mayer, H., Hirschmüller, H. & Scharstein, D. (2014): A TV Prior for High-Quality Local Multi-View Stereo Reconstruction. International Conference on 3D Vision, pp. 65–72.

[4] Mayer, H., Bartelsen, J., Hirschmüller, H. & Kuhn, A. (2012): Dense 3D Reconstruction from Wide Baseline Image Sets. In: Dellaert et al. (Eds.): Outdoor and Large-Scale Real-World Scene Analysis, 15th International Workshop on Theoretical Foundations of Computer Vision, Lectures Notes in Computer Science (LNCS), Vol. 7474, pp. 285–304.

[5] Nguatem, W., Drauschke, M. & Mayer, H. (2014): Localization of Windows and Doors in 3D Point Clouds of Facades. International Annals of the Photogrammetry, Remote Sensing and Spatial Information Sciences, Volume II-3, pp. 87–94.

[6] Nguatem, W., Drauschke, M. & Mayer, H. (2016): Automatic Generation of Building Models with Levels of Detail 1–3. International Archives of Photogrammetry, Remote Sensing and Spatial Information Sciences, Vol. XLI-B3, pp. 649–654.